Laura tiene una boutique especializada en ropa para mujeres trabajadoras. Después de reiteradas solicitudes de su clientela frecuente de un activo en línea (sitio web o tienda de Facebook) donde pudieran pedir su ropa, Laura decidió invertir en un sitio web con una plataforma de comercio electrónico integrada. Cuando se lanzó el sitio web, Laura esperaba que sus pedidos aumentaran. Todo fue como se esperaba durante un par de meses. Luego comenzó a observar que un par de clientes habituales volvían a solicitar el catálogo a través de WhatsApp en lugar de visitar la última colección en el sitio web. Ella decidió investigar. Se sorprendió cuando le dijeron que algunas de las reseñas publicadas en su sitio web eran totalmente ofensivas, acompañadas también de algunas fotos objetables. Por lo tanto, evitaban visitar el sitio web y solicitar el último catálogo a través de WhatsApp, como lo hacían antes.

Lo que Laura tenía que hacer era usar la moderación de contenido en su sitio web. El monitoreo del contenido generado por el usuario (UGC) en una plataforma en línea y la aplicación de un conjunto predeterminado de pautas para descartar el contenido ofensivo se denomina moderación de contenido. Con la fácil disponibilidad de Internet de alta velocidad y el uso cada vez mayor de teléfonos inteligentes, la cantidad de contenido generado por el usuario en cualquier plataforma e Internet, en general, aumenta día a día. En mayo de 2019, cada minuto se subían a YouTube 500 horas de vídeo. Y los usuarios de Facebook suben 350 millones de fotos todos los días. Esto también ha llevado a un aumento exponencial del contenido insensible.

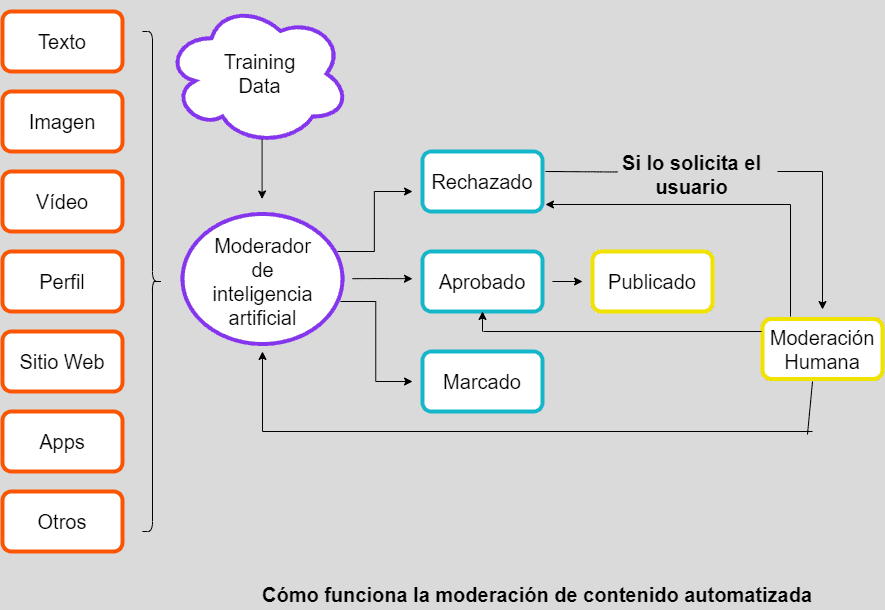

Cómo funciona la moderación de contenido

La forma más sencilla de moderar el contenido es examinarlo y analizarlo antes de que se publique para consumo público. Los creadores de contenido envían su contenido para su revisión y se publica solo después de que los moderadores lo aprueben. En algunos casos, como las reseñas de productos en una plataforma de comercio electrónico, esto puede resultar frustrante para el usuario. Y también, potencialmente resultará en una disminución del compromiso del cliente. Según lo encontrado por AdWeek, el 85% de los usuarios están más influenciados por el contenido generado por el usuario en comparación con el contenido publicado directamente por las propias marcas.

Esto se puede solucionar permitiendo que el contenido se publique de inmediato, pero también colocándolo para moderación en la cola de moderadores. Si el contenido se considera ofensivo, se puede eliminar después de que el moderador de contenido lo marque. La desventaja aquí es que algunos usuarios podrían haber visto el contenido ofensivo antes de que se elimine. Depende de la empresa decidir cuánto contenido confidencial pueden tolerar en su plataforma antes de que pueda moderarse y eliminarse.

Según el informe de investigación de mercado de Data Bridge, el mercado global de soluciones de moderación de contenido crecerá a una CAGR del 10,7 % hasta 2027. Los líderes tecnológicos como Microsoft, IBM y Alphabet están desarrollando soluciones en la nube y en las instalaciones para ayudar a las empresas de todos los tamaños a moderar el UGC en sus plataformas. Profundicemos en lo que realmente hacen por su negocio.

Cómo identificar contenido sensible para moderación

Hablamos repetidamente de contenido ofensivo, contenido sensible y reglas predeterminadas para moderar contenido. Esto exige una discusión sobre qué es un contenido sensible. Cualquier contenido, ya sea texto, imagen, video, audio o cualquier otra forma, que muestre violencia, desnudez o discurso de odio puede denominarse contenido sensible. Las reglas que determinan qué contenido es confidencial dependen de los requisitos específicos de la plataforma. Si una empresa quiere promover la libertad de expresión, se pueden permitir muchos contenidos que de otro modo estarían apagados y seguros.

Hay muchos factores que deben tenerse en cuenta al decidir las reglas para la moderación:

- Datos demográficos de los visitantes: si muchos jóvenes usan una aplicación o plataforma, la moderación del contenido debe garantizar que no estén expuestos a ningún tipo de contenido sensible.

- Expectativas de los usuarios: si los usuarios esperan que su contenido se publique de inmediato, la empresa deberá encontrar una manera de hacerlo mientras filtra el contenido confidencial.

- Calidad del contenido: a medida que avanza la tecnología, los usuarios esperan una mayor calidad del contenido, incluso después de haberlo moderado. Por lo tanto, pixelar todas las imágenes ofensivas puede que ya no sea una idea factible.

- Contenido duplicado: es un problema real en Internet, especialmente en los foros de discusión y los sitios de redes sociales. Para mantener su integridad y confiabilidad, las empresas deben eliminar el contenido duplicado lo más rápido posible.

La moderación de contenido es una actividad altamente especializada y las empresas que se toman en serio deben contar con la ayuda de expertos para elaborar reglas de moderación y establecer sistemas que implementen esas reglas con éxito. Cualquier error en la moderación del contenido puede resultar en pérdida de negocio y credibilidad, como vimos en el caso de Laura.

La IA ayuda a moderar el contenido

La gran cantidad de datos que generan los usuarios hace que sea casi imposible que los humanos moderen el contenido por su cuenta. La Inteligencia Artificial ha solucionado en gran medida este problema. El enfoque más reciente para la moderación de contenido es una combinación de inteligencia artificial y moderación humana, donde los sistemas de inteligencia artificial se encargan de la mayor parte de la carga de trabajo rutinaria.

El COVID-19 obligó a las personas a quedarse en casa, los esfuerzos de moderación se han visto afectados. Debido a cuestiones legales, de privacidad y de seguridad, los moderadores de contenido no pueden acceder desde casa a todos los tipos de contenido. Los sistemas de IA para la moderación de contenido están encontrando una rápida adopción debido a la no disponibilidad forzada de moderadores humanos.

Entendamos cómo funciona el sistema de moderación de contenido de IA en conjunto con los moderadores humanos.

La IA ayuda a moderar el contenido

La gran cantidad de datos que generan los usuarios hace que sea casi imposible que los humanos moderen el contenido por su cuenta. La Inteligencia Artificial ha solucionado en gran medida este problema. El enfoque más reciente para la moderación de contenido es una combinación de inteligencia artificial y moderación humana, donde los sistemas de inteligencia artificial se encargan de la mayor parte de la carga de trabajo rutinaria.

Con COVID-19 obligando a las personas a quedarse en casa, los esfuerzos de moderación se han visto afectados. Debido a cuestiones legales, de privacidad y de seguridad, los moderadores de contenido no pueden acceder desde casa a todos los tipos de contenido. Los sistemas de IA para la moderación de contenido están encontrando una rápida adopción debido a la no disponibilidad forzada de moderadores humanos.

Entendamos cómo funciona el sistema de moderación de contenido de IA en conjunto con los moderadores humanos.

- Todo el contenido, ya sea que haya sido publicado o no, se envía para moderación al sistema de IA.

- Sobre la base de un conjunto predeterminado de normas y reglamentos que se introducen en el sistema, se filtra el contenido. El contenido ofensivo y subido de tono se trata luego como se especifica en las pautas; puede eliminarse por completo o filtrarse.

- Parte del contenido está marcado para moderación humana, nuevamente según las pautas.

- Después de que los moderadores humanos vean el contenido marcado, los comentarios vuelven al algoritmo de moderación para que el algoritmo de IA pueda moderar el contenido de manera adecuada. Por lo tanto, el sistema se capacita continuamente a través de la experiencia humana.

- Se toman las medidas apropiadas en el contenido moderado.

Los moderadores humanos aportan contexto cultural al proceso de moderación. Entienden la psicología detrás del contenido porque entienden el tipo de usuarios con los que están tratando. Porque siempre hay una zona gris de moderación en la que no es posible establecer claramente si clasificar el contenido como completamente ofensivo o completamente inofensivo; depende del contexto. Aquí es donde entra en juego la experiencia de los moderadores humanos.

Tipos de contenido que necesitan ser moderados

Más de 1 millón de personas se han estado conectando todos los días, desde enero de 2018. La mayoría de ellos son responsables de generar contenido en plataformas que permiten a los usuarios. Por lo menos, la participación en las redes sociales genera enormes cantidades de UGC. Esto conduce a un aumento en la variedad de contenido que debe pasar por el proceso de moderación. Veamos algunos de ellos aquí.

Moderación de texto

Cualquier sitio web o aplicación que acepte contenido generado por el usuario puede tener una amplia variedad de texto publicado. Si no lo cree, piense en los comentarios, debates en foros, artículos, etc. que anima a sus usuarios a publicar. En el caso de sitios web que tienen bolsas de trabajo o tablones de anuncios, el rango de texto a moderar aumenta aún más. Moderar texto es especialmente complicado porque cada pieza de contenido puede variar en longitud, formato y estilo.

Además, el lenguaje es a la vez complejo y fluido. Las palabras y frases que pueden parecer inocentes por sí mismas se pueden juntar para transmitir un significado ofensivo. Incluso si se trata de una cultura o comunidad específica. Para la detección de ciberdelitos como el bullying o el trolling, es necesario examinar las frases o párrafos escritos. Una lista general de palabras clave o frases que deben eliminarse para descartar el discurso de odio o la intimidación no es suficiente.

Moderación de imágenes

Aunque es más fácil moderar imágenes que texto, la moderación de imágenes tiene sus propias complejidades. La misma imagen que es aceptable para un país o cultura puede ser ofensiva para otro. Si tiene un sitio web o una aplicación que acepta imágenes de los usuarios, deberá moderar el contenido según las expectativas culturales de la audiencia.

Moderación de videos

Moderar videos requiere mucho tiempo porque los moderadores deben verlos de principio a fin. Incluso un solo cuadro de contenido ofensivo o sensible es suficiente para antagonizar a los espectadores. Si su plataforma permite el envío de videos, deberá realizar grandes esfuerzos de moderación para garantizar que no se infrinjan las pautas de la comunidad. Los videos a menudo tienen subtítulos, transcripciones y otras formas de contenido adjunto. Una moderación de extremo a extremo también requiere una investigación explícita de estos componentes. Esencialmente, la moderación de video también puede terminar encapsulando la moderación de texto.

Moderación de perfil

Cada vez más empresas alientan a sus usuarios a registrarse en sus sitios web o aplicaciones para comprender el comportamiento y las expectativas de los clientes. Sin embargo, esto ha agregado otro tipo de contenido que debe ser moderador: perfiles de usuario. La moderación del perfil puede parecer simplista, pero es esencial hacerlo 100% correcto. Los usuarios deshonestos registrados en su plataforma pueden destruir la imagen y la credibilidad de su marca. Por otro lado, si puede examinar los perfiles con éxito, puede estar seguro de que el contenido publicado por ellos necesitará una moderación mínima.

Tipos de moderación de contenido

El método de moderación de contenido que adopte debe depender de sus objetivos comerciales. Al menos el objetivo de su aplicación o plataforma. ¿Quieres que los usuarios puedan publicar contenido rápidamente? ¿Es más importante para usted que no se muestre ningún contenido sensible ni siquiera momentáneamente? ¿Puede confiar en sus propios usuarios para moderar el contenido generado por sus pares? Analicemos los diferentes tipos de métodos de moderación de contenido que se utilizan y luego podrá decidir cuál es mejor para usted.

Pre-moderación

Como sugiere el nombre, todos los envíos de los usuarios se ponen en cola para moderación antes de que se muestren en la plataforma como delitos cibernéticos. La moderación previa garantiza que nunca se publique contenido confidencial (un comentario, una imagen o un video) en un sitio. Pero esto puede resultar un obstáculo para las comunidades en línea que desean un compromiso inmediato y sin restricciones. La moderación previa se adapta mejor a las plataformas que requieren los niveles más altos de protección, como las aplicaciones para niños.

Posmoderación

La moderación posterior permite a los usuarios publicar sus envíos de inmediato, pero los envíos también se agregan a una cola para la moderación. Si se encuentra algún contenido sensible, se elimina de inmediato. Esto aumenta la responsabilidad de los moderadores porque, idealmente, no debería haber contenido inapropiado en la plataforma si todo el contenido pasa por la cola de aprobación.

Moderación reactiva

Las plataformas que tienen una gran cantidad de miembros de la comunidad de delitos cibernéticos les piden a los usuarios que marquen cualquier contenido que consideren ofensivo o no de acuerdo con las pautas de la comunidad. Esto permite a los moderadores centrarse en el contenido que ha sido marcado por la mayor cantidad de usuarios. Pero esto también puede permitir que el contenido confidencial circule en una plataforma durante mucho tiempo. Depende de sus objetivos comerciales cuánto tiempo puede tolerar que se muestre contenido confidencial.

Moderación del supervisor

La moderación del supervisor es los delitos cibernéticos una forma más enfocada de moderación reactiva. Aquí se selecciona un grupo de moderadores de la propia comunidad en línea, que tiene el poder de modificar o eliminar los envíos de delitos cibernéticos si son ofensivos o no siguen las pautas de la comunidad. Sin embargo, las preferencias personales de los moderadores afectan el nivel de moderación. Además, su cantidad de personas se dedican con moderación, que no están también capacitadas en esta disciplina, algunos contenidos ofensivos podrían pasar desapercibidos.

Moderación automatizada

En la moderación automática, se utiliza una variedad de herramientas y técnicas para filtrar, marcar o rechazar por completo el contenido ofensivo. Por lo general, el contenido pasa primero por un algoritmo que busca la aparición de palabras restringidas y verifica que el contenido no provenga de direcciones IP bloqueadas. Como se discutió anteriormente, elabore sistemas de inteligencia artificial y utilícelos para analizar contenido de texto, imagen y video. Finalmente, los moderadores humanos pueden estar involucrados en los sistemas automatizados que señalan algo para su consideración.

Dependiendo de la sensibilidad de la plataforma, una empresa puede optar por publicar contenido en cualquier etapa de moderación. Por ejemplo, el contenido de texto podría publicarse después de filtrar las palabras restringidas, y la moderación de su significado y contexto puede continuar en paralelo. Esto garantiza una publicación de contenido más rápida, lo que puede ser una consideración importante en el contenido generado por el usuario.

Desafíos en la moderación de contenido

Queda claro de nuestra discusión hasta ahora que cualquier empresa que tenga presencia en línea necesita moderar el contenido generado por el usuario en sus plataformas. Estos son algunos de los desafíos más comunes que enfrentan, según su tamaño, presencia en línea, nivel de participación de los usuarios y tipo de contenido que publican los usuarios.

- Bienestar emocional de los moderadores de contenido: los moderadores de contenido humano están expuestos a violencia extrema y gráfica, experiencias horribles de contenido explícito. La exposición continua a dicho contenido puede tener impactos mentales como el trastorno de estrés postraumático, el agotamiento mental y otros trastornos de salud mental.

- Tiempo de respuesta rápido: cada empresa tiene múltiples plataformas en línea para administrar en un momento dado y hay diferentes tipos de contenido que se cargan cada minuto. Para colmo, los usuarios esperan que el contenido se modere rápidamente. Administrar esta carga, incluso cuando los procesos están automatizados en gran medida, es un desafío.

- Atender a diversas culturas y expectativas: como se mencionó anteriormente, lo que es aceptable para una comunidad puede ser ofensivo para otra y viceversa. Las empresas deben localizar sus esfuerzos de moderación para que puedan cumplir con las expectativas de sus diversas audiencias.

Drago’s House puede ayudar a diseñar soluciones de moderación de contenido

Si su empresa tiene presencia en línea, ya sea un sitio web, una aplicación, identificadores de redes sociales o foros de discusión, debe moderar el contenido generado por los usuarios en todas sus plataformas para generar imagen de marca y lealtad.

Nuestro equipo de expertos en soluciones de Azure Content Moderator puede ayudarlo a analizar y comprender sus requisitos. Como se discutió, establecer las pautas para identificar contenido sensible es el primer paso más importante de la estrategia de moderación de contenido. Nuestros expertos ayudan a diseñar estas pautas y luego integran el desarrollo de inteligencia artificial (IA) y el aprendizaje automático con otras tecnologías como el desarrollo de Blockchain y el crowdsourcing para desarrollar una solución de moderación de contenido automatizada eficiente.

Resumen

Revisar el contenido generado por el usuario en cualquier plataforma en línea y descartar el contenido ofensivo según un conjunto predeterminado de pautas se denomina moderación de contenido. Los textos, fotos, videos, audios o cualquier otro tipo de contenido que muestre violencia, incitación al odio o desnudez pueden denominarse contenido sensible. Sin embargo, la responsabilidad final de categorizar cualquier contenido como ofensivo o sensible recae completamente en el negocio que modera el contenido.

Establecer pautas claras para moderar contenido es el primer paso más importante para construir una estrategia efectiva de moderación de contenido. Más de 1 millón de personas se han estado conectando en línea desde enero de 2018. Esta gran cantidad de usuarios de Internet garantiza que millones de fotos, videos o contenido de texto se carguen continuamente en cada plataforma. No es posible que los moderadores humanos asuman una carga completa de moderación.

En los últimos años, los esfuerzos de moderación de contenido se distribuyen entre los sistemas de inteligencia artificial y los moderadores humanos. Todo el contenido que debe moderarse se envía al sistema, que lo filtra sobre la base de las pautas de moderación que se le han dado. El contenido aprobado se publica, mientras que algunos sistemas conscientes del contenido no pueden decidir si es sensible o no, y se marcan para moderación humana. Los revisores humanos ven el contenido marcado y toman una decisión sobre su idoneidad.

La revisión humana también se envía de vuelta al sistema de IA como retroalimentación de entrenamiento. Hay diferentes enfoques para moderar el contenido. Algunas empresas quieren moderar el contenido antes de publicarlo, mientras que otras lo publican y, al mismo tiempo, lo ponen en cola para su moderación. Algunas plataformas también eligen moderadores de su base de usuarios o permiten que todos los usuarios marquen el contenido que consideran inapropiado.

La moderación de contenido es emocionalmente muy desafiante para los moderadores humanos. La exposición continua a la violencia, el discurso de odio, el terrorismo o la intimidación causan estragos en su salud mental y algunos de ellos muestran síntomas del trastorno traumático post-estrés. Además de responder rápidamente a las expectativas de moderación de los usuarios, las empresas también deben adaptar sus pautas de moderación de contenido según la comunidad o el país en el que reside su audiencia.